Вчера Apple провела свое мероприятие WWDC 2025 и фактически ушла сразу с Apple Intelligence, а затем рассказала о своем визуальном интеллекте Apple. По сути, Apple сказала, что им нужно усовершенствовать его, поэтому в следующем году будет что -то еще.

Apple Intelligence

Craig Federighi, SVP, разработка программного обеспечения в Apple сказал в отношении Apple Intelligence:

И когда мы поделились, мы продолжаем нашу работу, чтобы предоставить функции, которые делают Siri еще более личными. Эта работа потребовалось больше времени, чтобы достичь нашего высококачественного бара, и мы с нетерпением ждем возможности поделиться об этом в следующем году.

Apple объявила о новой языковой поддержке, вот полный список языков, поддерживаемых Apple Intelligence, идущих с iOS26 (новое название для предстоящего выпуска iOS):

- Французский

- немецкий

- Итальянский

- Португальский (Бразилия)

- испанский

- Китайский (упрощен)

- Японский

- корейский

- Английский

- Датский

- Голландский

- норвежский

- Португальский (Португалия)

- Шведский

- турецкий

- Китайский (традиционный)

- вьетнамский

Он также объявил, что разработчики приложений смогут использовать Apple Intelligence для своих приложений. Он сказал, что новая «Foundation Models Framework» позволяет разработчикам приложений использовать модели на устройстве, все это сделаны на устройстве, а не в облаке, и, следовательно, никаких затрат, никаких проблем с конфиденциальностью и автономной поддержки.

Эта часть началась на отметке 6:32 и закончилась в 9:50:

https://www.youtube.com/watch?v=0_djddfqtue

Apple Visual Intelligence

Затем на 40 -минутной отметки Крейг рассказал о визуальном интеллекте Apple. В прошлом году мы рассмотрели ряд функций, некоторые из которых были запущены, а некоторые никогда не запущены. Я не видел интеграции Близнецов.

В любом случае, вот некоторые из новых функций, которые он демонстрировал вокруг Apple Visual Intelligence.

Экриншот для поиска: когда вы сделаете снимок экрана, вы увидите внизу «Спросите» и «Поиск изображений».

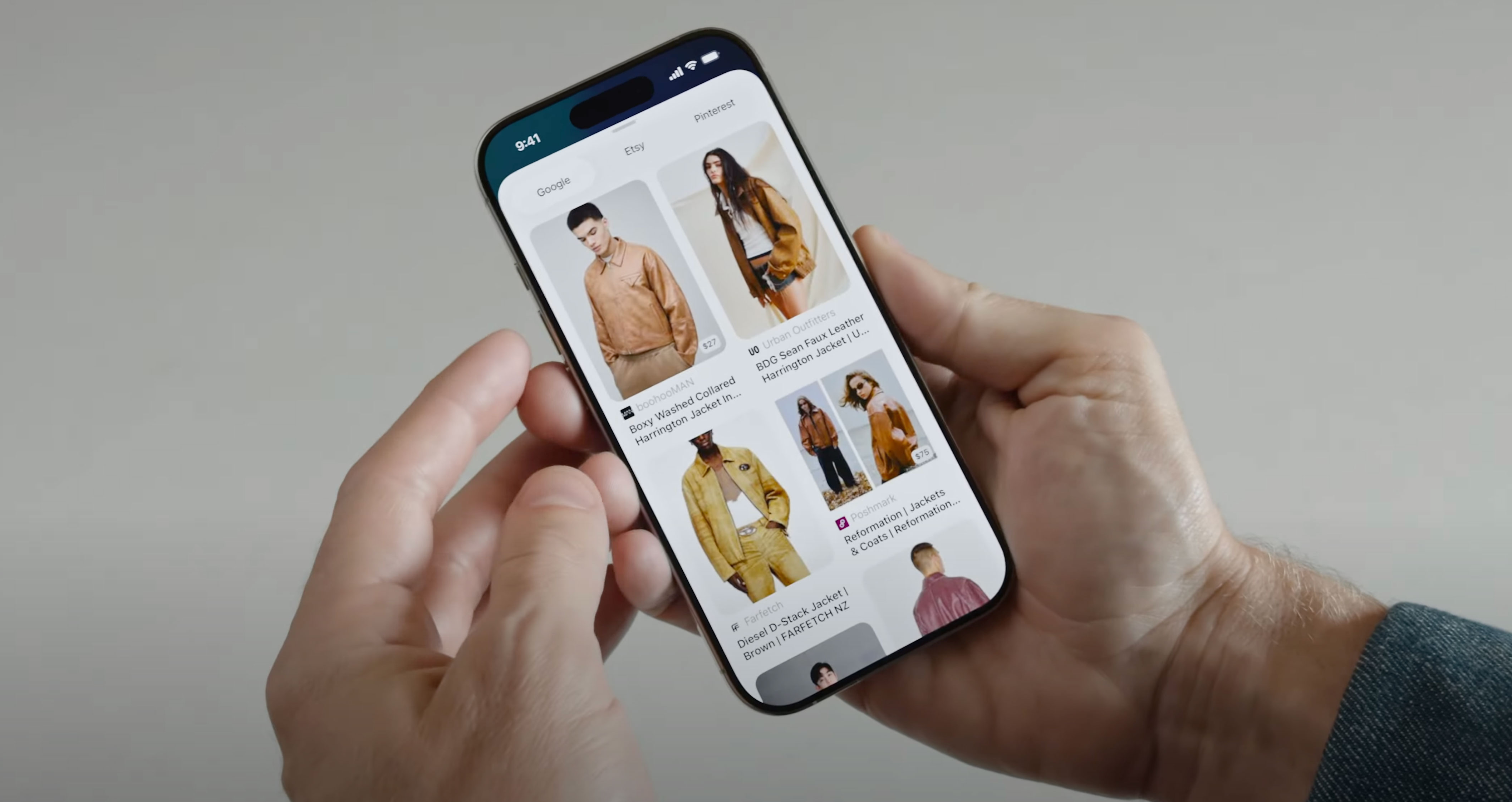

Нажав «Поиск изображения», найдет соответствующие изображения в Google или сторонних приложениях:

Вы также можете выделить поиск в определенной части экрана, например, Fulce Google для поиска:

А потом «Спросить» позволит вам задать вопросы о том, что вы смотрите — т.е. мультимодаль:

Конечно, сейчас живой поиск Google сейчас гораздо более впечатляет.

Вот видео на 40 -минутной отметке, чтобы вы тоже могли посмотреть эту часть — это меньше 4 минут:

https://www.youtube.com/watch?v=0_djddfqtue

Вот что является новым с Apple Intelligence и Apple Visual Intelligence для iOS26.

Обсуждение на форуме в ХПолем